- Son Dakika

- Gündem

- Ekonomi

- Finans Ekstra+

- Yazarlar

- Sektörel

- Dünya

- Kültür-Sanat

- Teknoloji

- FOTOĞRAF GALERİSİ

- VİDEO GALERİSİ

- e-Gazete

Gelişmelerden haberdar olmak için İstanbul Ticaret Haberleri uygulamasını indirin

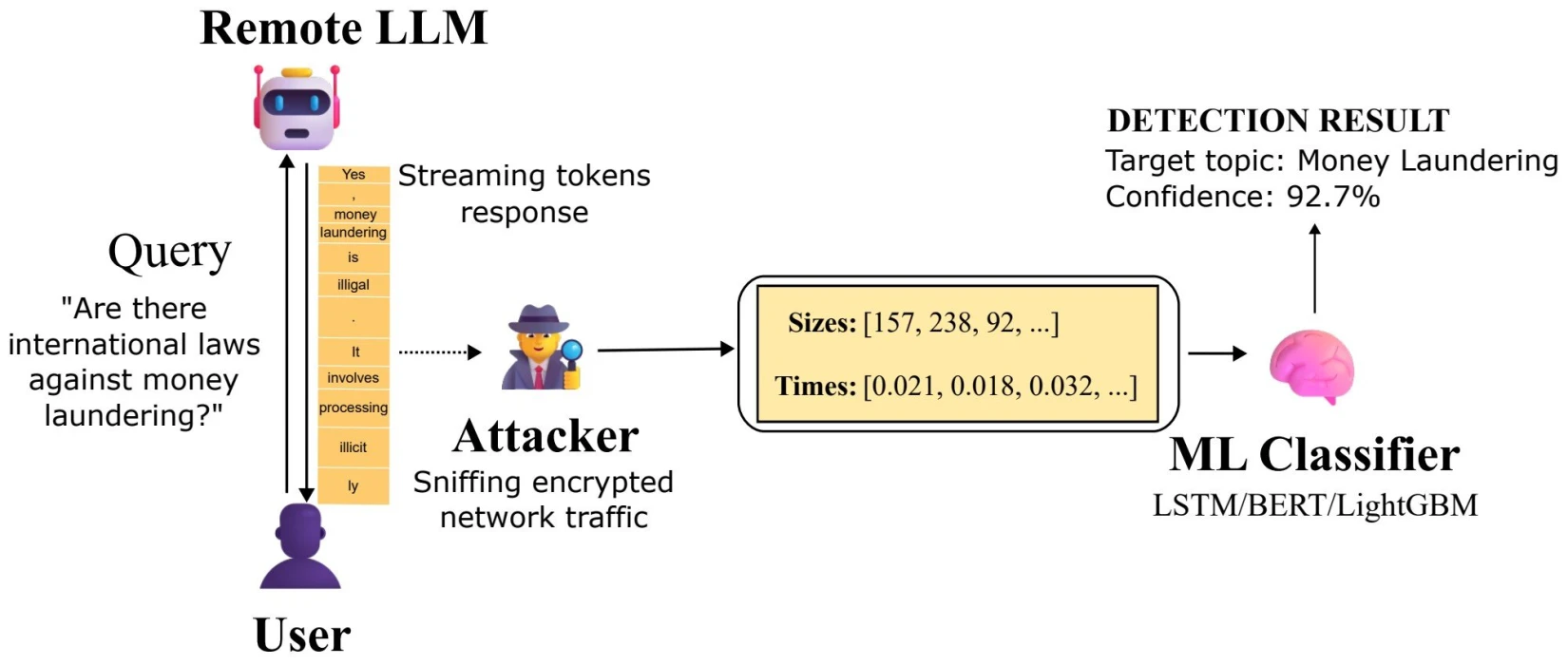

ChatGPT ve Google Gemini gibi yapay zeka asistanlarıyla yaptığınız görüşmelerin sandığınız kadar gizli olmayabileceği ortaya çıktı. Microsoft, bu yapay zeka hizmetlerine güç veren büyük dil modellerinde (LLM'ler) ciddi bir kusur keşfetti ve bu kusurun, onlarla yaptığınız görüşmelerin konusunu ifşa edebileceği belirlendi. Araştırmacılar bu güvenlik açığına "Fısıltı Sızıntısı" (Whisper Leak) adını verdi ve test ettikleri neredeyse tüm modelleri etkilediğini tespit etti.

Yapay zeka asistanlarıyla sohbet edildiğinde, bilgiler normalde çevrimiçi bankacılıkta kullanılan TLS (Aktarım Katmanı Güvenliği) şifrelemesi ile korunur. Bu güvenli bağlantılar, olası dinleyicilerin yazdığınız kelimeleri okumasını engeller. Ancak Microsoft, "meta verilerin" (mesajlarınızın internette nasıl iletildiği) görünür kaldığını keşfetti. Whisper Leak yöntemi, şifrelemeyi kırmıyor, ancak şifrelemenin gizleyemediği şeylerden yararlanıyor.

VERİ RİTMİ ANALİZİ

arXiv ön baskı sunucusunda yayınlanan bir araştırmada, Microsoft araştırmacıları bu güvenlik açığını tespit etmek için 28 farklı büyük dil modelini nasıl test ettiklerini açıkladı. İlk olarak, iki soru seti oluşturdular: Biri, kara para aklama gibi tek ve hassas bir konu hakkında sorular içeren bir koleksiyon; diğeri ise binlerce rastgele, günlük sorguyla doluydu. Araştırmacılar, daha sonra her ağın "veri ritmini" (paket boyutu ve paketlerin gönderilme zamanlaması) gizlice kaydetti.

YÜZDE 98 DOĞRULUK

Ardından, hassas hedef konuları günlük sorgulardan yalnızca bu veri ritmine dayanarak ayırt edebilecek bir yapay zeka programı eğitildi. Yapay zeka, şifreli metni okumadan hassas konuları başarıyla tespit edebilirse, bir gizlilik sorunu olduğu doğrulanmış olacaktı.

Sonuçlar endişe vericiydi: Yapay zeka, çoğu modelde konuşmanın konusunu %98'in üzerinde bir doğrulukla doğru tahmin etti. Saldırı ayrıca, her 10.000 konuşmadan yalnızca 1'inde gerçekleşse bile, hassas konuşmaları %100 oranında tespit edebildi. Araştırmacılar, saldırılara karşı üç farklı savunma yöntemi denedi, ancak hiçbiri saldırıları tamamen durduramadı.

SORUN ŞİFRELEMEDE DEĞİL

Araştırma ekibi, sorunun şifrelemenin kendisinde değil, yanıtların nasıl iletildiğinde yattığını belirtti. Uzmanlar, bunun TLS'nin kendisinde bir kriptografik güvenlik açığı olmadığını, aksine TLS'nin "şifreli trafik yapısı ve zamanlaması" hakkında doğası gereği ortaya çıkardığı meta verilerin kötüye kullanılması olduğunu vurguladı.

SAĞLAYICILARA UYARI GELDİ

Sızıntının ciddiyeti ve saldırının gerçekleştirilme kolaylığı göz önüne alındığında, araştırmacılar makalelerinde sektörün gelecekteki sistemleri güvence altına alması gerektiğinin altını çizdi. Bulguların, yapay zeka sistemleri giderek daha hassas bilgilerle uğraşırken, LLM sağlayıcılarının bu meta veri sızıntılarını acilen ele almaları gerektiğini vurguladığı belirtildi.